El año en que la nube se volvió estrategia, no destino

La nube dejó de ser un lugar y pasó a ser una forma de operar. Las organizaciones combinan regiones públicas, infraestructura privada y nubes soberanas, mientras automatizan despliegues y orquestan cargas con IA. Las prioridades cambiaron por presión regulatoria, costos del cómputo para modelos y necesidad de baja latencia.

El resultado es una arquitectura híbrida y multicloud donde elasticidad, portabilidad y control del dato pesan tanto como la velocidad de entrega. En 2025, la discusión es estratégica: ¿cómo moverte entre nubes sin perder seguridad, cumplimiento y performance?

IA integrada a la operación: del experimento al plano de control

Tras dos años de pilotos, la IA se incrusta en la cadena de software y en la operación de plataformas. Equipos de infraestructura usan copilotos y asistentes para describir recursos, diagnosticar fallas y ajustar capacidades con lenguaje natural. Los mismos motores ayudan a detectar anomalías, correlacionar logs y recomendar remediaciones antes de que el usuario final note una degradación. La IA deja de ser “una app aparte” y se vuelve interfaz operativa de la nube, acortando ciclos de investigación y mejorando el MTTR.

Esta integración obliga a gobernar prompts, permisos y telemetría, porque los asistentes ven estados sensibles del entorno y pueden ejecutar cambios de alto impacto. La pregunta clave ya no es “¿qué modelo uso?”, sino “¿qué guardrails aplico para que estos agentes operen con contexto, auditoría y mínimos privilegios?”.

Edge inteligente: cómputo cerca del dato, modelos cerca del evento

El auge del edge no es un revival del on-premise: es una extensión programada del cloud hacia el lugar donde se generan señales críticas. Fábricas, retail, energía y salud ejecutan inferencia local para filtrar datos y responder en milisegundos, mientras envían al cloud solo lo que requiere agregación o entrenamiento. La topología se vuelve jerárquica: sensores y gateways con contenedores livianos, micro-servicios en zonas locales metropolitanas y clústeres regionales para cargas intensivas.

Esta capa “inteligente” equilibra latencia y soberanía con control centralizado. Llevar modelos al borde exige toolchains reproducibles, firmas y atestación del entorno; además, pipelines para actualizar versiones sin interrumpir operaciones. En 2025, el edge deja de ser “sitios remotos con cache” y pasa a ser un plano activo con IA, donde cada milisegundo ganado es ahorro de costos o mejor experiencia.

Soberanía y residencia: la política de datos manda sobre la topología

La expansión regulatoria pone la soberanía de datos al centro del diseño de nube. En Europa, nuevas obligaciones de portabilidad y “cloud switching” presionan por interoperabilidad contractual y técnica. A la par, los hiperescalares ofrecen controles regionales más estrictos, límites a movimientos de datos y operación local. Esto no es solo cumplimiento: reduce riesgos legales y facilita vender en mercados exigentes.

Para LatAm y empresas globales, el patrón se repite con matices locales: reglas de transferencias, contratos modelo y autoridades más activas. De aquí nace la arquitectura “control plane aware”: etiquetas de datos, políticas de enrutamiento, llaves administradas por el cliente y segmentación por jurisdicción. El dilema deja de ser dónde corren los contenedores y pasa a ser quién puede ver, mover o tocar los metadatos que describen al cliente.

Híbrida y multicloud por diseño: mover cargas sin rehacer todo

La multicloud maduró. Ya no se trata de “diversificar proveedores”, sino de definir compatibilidad entre planos de identidad, redes, K8s y artefactos. Las organizaciones eligen un conjunto de primitivos comunes y evitan acoplamientos a servicios que ataquen el lock-in. Cuando un servicio gestionado aporta mucha ventaja, lo encapsulan detrás de interfaces y políticas portables.

El “pegamento” es GitOps y política como código: un repositorio describe el estado deseado y el mismo pipeline aplica cambios en clusters y cuentas de distintas nubes. Así, portar una carga es re-apuntar variables y credenciales, no reescribir sistemas. El objetivo 2025 no es “ser multi por todo”, sino “ser movible cuando conviene”: resiliencia contractual, alternativas técnicas reales y costos previsibles al migrar.

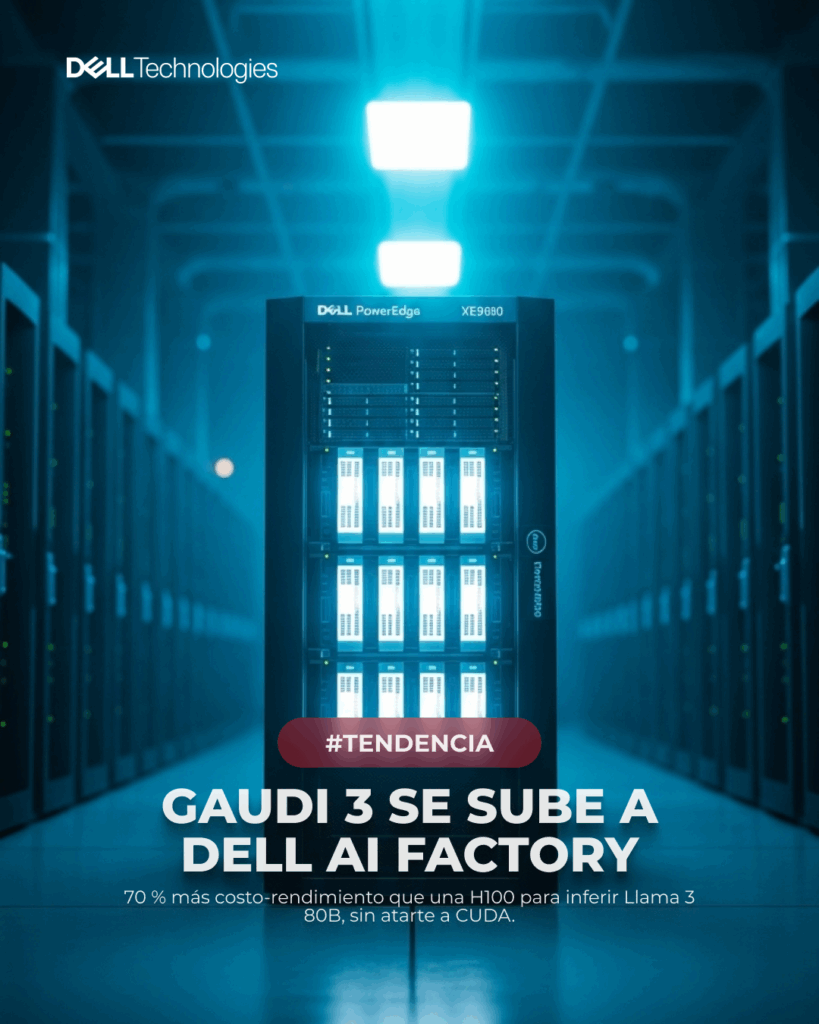

Elasticidad y rendimiento: serverless y autoscaling con unit economics

El cómputo elástico sigue ganando terreno porque alinea gasto con uso. Funciones, contenedores gestionados y jobs bajo demanda escalan a cero y vuelven a picos en segundos, lo que cuida el TCO de cargas intermitentes y servicios con tráfico irregular. Las plataformas suman métricas nativas para autoscaling por CPU, concurrencia o eventos, y streaming de respuestas para acortar TTFB.

La madurez no está solo en la tecnología: FinOps integra licencias, PaaS y SaaS, y empuja “unit economics” por producto o feature. Esto permite aceptar costos de IA donde hay retorno medible y apagar derivas invisibles en tiempos de baja. En 2025, elasticidad no es “pagar menos”; es perseguir latencia objetivo y calidad con costo por unidad clara, auditada y atribuible.

LatAm y Argentina: proximidad, latencia y cumplimiento práctico

Para la región, la llegada de nuevas regiones y zonas locales reduce la distancia física y regulatoria. Empresas argentinas y del Cono Sur ya pueden combinar regiones en Brasil o Chile con zonas locales en Buenos Aires para acercar workloads sin renunciar a servicios administrados. Esto habilita patrones mixtos: inferencia en borde urbano, datos sensibles en jurisdicción regional y entrenamiento en regiones con mejor precio-performance.

La captura de valor depende de tres decisiones: clasificar datos por sensibilidad y país, definir ruta de despliegue por latencia y costos, y negociar contratos que habiliten salida y portabilidad. El mercado laboral acompaña con perfiles de plataforma que cruzan seguridad, redes y MLOps. El resultado es un mapa operativo donde cada workload tiene un “por qué” y un “dónde” justificable ante auditorías y finanzas.